En Avahi, siempre hemos creído que la IA es más que un simple avance en la automatización o el conocimiento, es una responsabilidad. A medida que miramos hacia el futuro en 2025, la conversación global ha madurado: ya no nos preguntamos simplemente: “¿Qué podemos construir?”, sino más bien: “¿Qué deberíamos construir y cómo debería comportarse?”

Con la derogación de la Orden Ejecutiva de la Casa Blanca de 2023 y la introducción de marcos integrales como la Ley de IA de la UE y las directrices de Ética de la IA de la UNESCO, el panorama regulatorio ha cambiado. Ahora, la IA opera bajo un escrutinio más estricto y, con ello, surge una mayor demanda de confianza, seguridad e imparcialidad.

En Avahi, no solo nos adaptamos a estos cambios, sino que ayudamos a darles forma. Hemos profundizado nuestras prácticas de IA responsable para cumplir con las realidades de la gobernanza actual, integrando principios de diseño ético directamente en nuestros flujos de trabajo, herramientas e infraestructura. Este blog describe cómo estamos ampliando nuestros pilares fundamentales con ejemplos del mundo real, casos de uso de clientes y salvaguardias evolucionadas que reflejan hacia dónde se dirige el ecosistema de la IA.

Nuestros pilares de la IA responsable

Basamos nuestro producto y sistema de IA que construimos en los siguientes ocho principios:

1. Imparcialidad y seguridad

Mitigar el sesgo y garantizar resultados equitativos en todas las interacciones de la IA.

Nuestro enfoque:

- Realizar auditorías internas de sesgo y evaluaciones de impacto antes de la entrega del proyecto a los clientes.

- Asociarse con las partes interesadas para definir métricas de imparcialidad adaptadas al contexto del mundo real, no solo a los puntos de referencia técnicos.

- Utilizar activamente las medidas de protección de AWS Bedrock y las indicaciones responsables para restringir los resultados sesgados.

Ejemplo: Indicación de IA de entrenador de salud

SYSTEM_PROMPT_STR = “”

Eres un entrenador de salud útil y empático. Genera una respuesta de apoyo y detallada utilizando el historial de conversación entre un paciente y su entrenador de salud, además de los datos JSON del paciente. – Utiliza ÚNICAMENTE los datos de ‘patient_json’ y la conversación para elaborar una respuesta precisa y empática. – NO inventes ni adivines detalles que no se proporcionen. – Tu respuesta debe ser desde la perspectiva de un entrenador de salud que ofrece consejos prácticos.

“”

Las salvaguardias clave en esta indicación incluyen:

- Empatía sin suposiciones: Evita explícitamente los estereotipos al basarse únicamente en los datos proporcionados.

- Prevención de alucinaciones: Prohíbe la especulación o la fabricación de detalles no verificados.

- Imparcialidad consciente del contexto: Las métricas se co-definen con las partes interesadas para la relevancia en el mundo real.

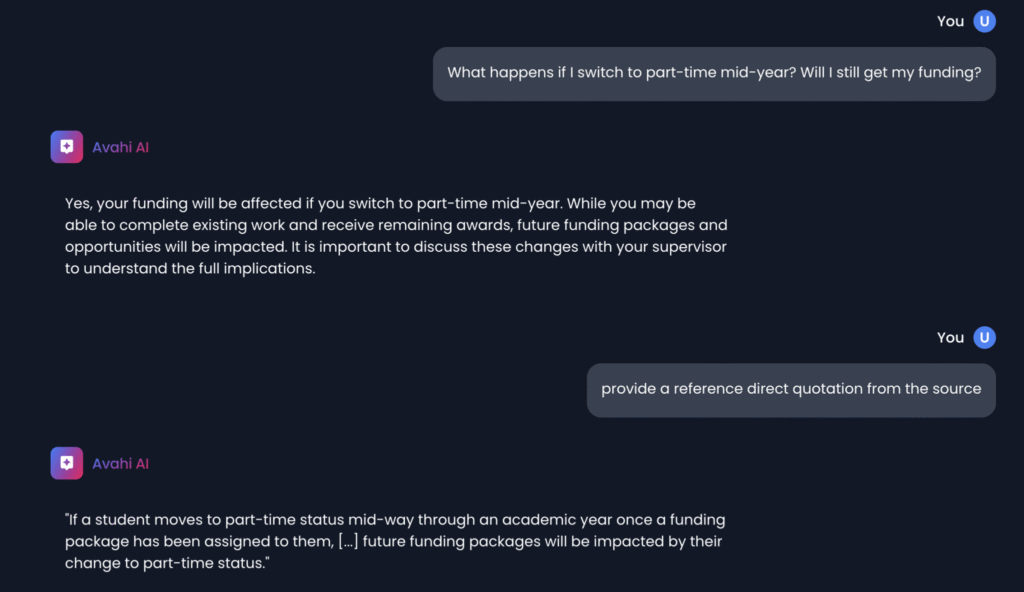

2. Transparencia y explicabilidad

Construir sistemas de IA que los usuarios y los reguladores puedan verificar y comprender.

Nuestros estándares:

- Entregar respuestas basadas en fuentes verificables (por ejemplo, políticas institucionales, documentos citados, documentos médicos).

- Proporcionar citas directas cuando los usuarios soliciten pruebas (ver ejemplo de captura de pantalla).

- Comunicar claramente las limitaciones, especialmente si se mencionan explícitamente en los documentos.

Ejemplo de captura de pantalla: Consulta de financiación universitaria

Queen’s University 7 Estudios de posgrado y asuntos postdoctorales

| Cambio | ¿Qué sucede con la financiación? | Consideraciones |

|---|---|---|

| Cambio de tiempo completo a tiempo parcial | Queen’s no garantiza la financiación para los estudiantes a tiempo parcial, ya que se entiende que los estudiantes a tiempo parcial están trabajando a tiempo completo. Si un estudiante pasa a tener un estatus de tiempo parcial a mitad de un año académico una vez que se le ha asignado un paquete de financiación, es posible que los estudiantes puedan completar cualquier tarea de trabajo restante y recibir cualquier premio restante afiliado a su paquete de financiación existente; sin embargo, los futuros paquetes de financiación se verán afectados por su cambio a un estatus de tiempo parcial. Normalmente, los puestos de asistente de enseñanza (TA) y los puestos de asistente de investigación (RA) se limitan a los estudiantes a tiempo completo. | El estudiante debe discutir los cambios en el estatus de estudio con su supervisor y considerar las implicaciones de financiación de dicho cambio, así como las implicaciones para cualquier ayuda provincial o nacional para préstamos, seguro médico o dental, o estatus de visa. |

| Cambio de tiempo completo a inactivo | Queen’s no garantiza la financiación para los estudiantes inactivos. Si un estudiante pasa a tener un estatus inactivo a mitad de un año académico una vez que se le ha asignado un paquete de financiación, el estudiante puede completar cualquier tarea de trabajo restante y recibir cualquier premio restante afiliado a su paquete de financiación existente. El estudiante no recibirá ningún paquete de financiación adicional hasta que reanude sus estudios a tiempo completo. |

El estudiante debe discutir los cambios en el estatus de estudio con su supervisor y considerar las implicaciones de financiación de dicho cambio, así como las implicaciones para cualquier ayuda provincial o nacional para préstamos, seguro médico o dental, o estatus de visa. |

Por qué es importante:

- Reduce el riesgo de desinformación: Las respuestas coinciden con los documentos fuente textualmente.

- Apoya la confianza: Los usuarios pueden verificar las afirmaciones a través de fuentes atribuibles.

- Traspaso humano: Señala cuándo se necesita la consulta de un experto.

3. Responsabilidad

Garantizar una responsabilidad clara por los resultados y las decisiones de la IA.

Nuestros protocolos:

- Demostraciones semanales a las partes interesadas durante el desarrollo para alinear los resultados y abordar las preocupaciones.

- Escalada humana para dominios de alto riesgo (por ejemplo, asesoramiento legal, médico, financiero).

- Descargos de responsabilidad para orientación no procesable (por ejemplo, “Esto no es asesoramiento legal”).

Ejemplo: flujo de trabajo de chatbot legal

Asistente: ¡Hola, bienvenido al chat en vivo de Attorney! Por favor, proceda y haga su pregunta.

Usuario: Quiero divorciarme

Asistente: Gracias por hacer su pregunta para obtener orientación sobre su asunto a través de la aplicación móvil Attorney Live. Tenga en cuenta que la información proporcionada a continuación no es asesoramiento legal, estamos proporcionando esta información general para aclarar su solicitud de asunto legal.

Entiendo que esta es una situación difícil. ¿En qué estado necesita asesoramiento legal con respecto a su divorcio?

Usuario: Texas

Asistente: Lamento mucho que esté pasando por esta situación difícil. ¿Cuáles son las principales razones por las que busca el divorcio? ¿Hay niños involucrados para los que sea necesario hacer arreglos de custodia?

Usuario: Sí, lo hemos intentado, pero eso no funcionó

Asistente: Lamento mucho escuchar que la consejería y la mediación no tuvieron éxito. ¿Ha discutido con su cónyuge los posibles arreglos de custodia y visitas para los niños? Es importante tratar de llegar a un acuerdo que sea en el mejor interés de los niños.

Usuario: No

Asistente: Según el contexto proporcionado, parece que está considerando el divorcio en Texas y tiene preocupaciones sobre la custodia de los hijos, la división de bienes y deudas. Este es un asunto legal complejo, especialmente cuando hay niños involucrados.

Recomendaría consultar con un abogado de derecho familiar con experiencia en Texas que pueda asesorarle sobre el proceso de divorcio, los arreglos de custodia de los hijos, la división de bienes/deudas y ayudar a garantizar que sus derechos y los mejores intereses de sus hijos estén protegidos. Un abogado puede guiarle a través de opciones como la mediación o el litigio si es necesario. La custodia de los hijos y la división de bienes pueden ser cuestiones emocionalmente cargadas. Tener la orientación objetiva de un abogado puede ser invaluable para alcanzar una resolución justa mientras se minimiza el conflicto. También pueden asegurarse de que se cumplan adecuadamente todos los requisitos legales en Texas.

Por favor, recuerde que la información proporcionada en este chat no es asesoramiento legal. Nuestro objetivo es guiarle hacia los próximos pasos prácticos, ya sea que eso implique consultar con un abogado o tomar otras medidas apropiadas. Le animamos amablemente a programar una consulta con un abogado a través de la aplicación Attorney Live, para que pueda obtener el apoyo personalizado que necesita.

Por qué funciona:

- Límites: Nunca diagnostica ni resuelve problemas legales directamente.

- Recopilación de contexto: Garantiza una comprensión matizada antes de responder.

- Traspaso ético: Dirige a los usuarios a expertos humanos cualificados.

4. Privacidad y seguridad de datos

Proteger los datos confidenciales a través del diseño de la infraestructura y los procesos.

Salvaguardias técnicas:

- Cifrado nativo de AWS: Protección de datos de extremo a extremo con políticas de IAM y registros de auditoría.

- Acceso con privilegios mínimos: Roles de IAM entre cuentas implementados en entornos de clientes para aislar los permisos.

- Anonimización compatible con HIPAA: Enmascaramiento de Pll para atención médica/legal (por ejemplo, [NOMBRE], [MEDICAMENTO]).

Manejo de datos:

- Retención cero: El procesamiento se realiza en la memoria; las entradas sin procesar nunca se almacenan.

- Reglas de enmascaramiento deterministas: Reemplazar Pll con marcadores de posición sin alterar el contexto (por ejemplo, conserva

“[DOSIS DE MEDICAMENTO]”).

Por qué los clientes confían en esto:

- Sin exposición entre proyectos: El acceso basado en roles se limita por compromiso.

- Alineación regulatoria: Cumple con GDPR, HIPAA y las leyes estatales de EE. UU. de 2025

5. Veracidad y solidez

Garantizar resultados precisos y fiables a través de controles técnicos y de proceso.

Ejemplo de enmascaramiento de PII:

masking_prompt =

"""

Please mask all personally identifiable information (PII), specifically:

First names

Last names

Addresses

Dates (birthdays, appointment dates)

Medication names

Medical professional names (Doctors, nurses)

Phone numbers

Emails

Text to mask:

{text}

Do not rewrite or rephrase the rest of the sentence.

Only replace PIl with generic placeholders or masked terms (e.g., [NAME], [MEDICATION], [DATE]). Do not add explanations,

greetings, or comments. ONLY the masked sentence.

"""

Características clave:

- Reglas estrictas de redacción: Sin anonimización generativa (previene alucinaciones).

- Conocimiento del contexto: Conserva el significado clínico/financiero (por ejemplo, “[DOSIS DE MEDICAMENTO]”).

- Listo para la auditoría: Todo el enmascaramiento se registra con roles de IAM y marcas de tiempo.

Por qué es importante:

- Previene la fabricación: Los resultados no pueden inventar detalles confidenciales.

- Mantiene la utilidad: Los datos enmascarados siguen siendo utilizables para el análisis.

5. Gobernanza – Adaptación a los nuevos estándares

Adaptar los sistemas de IA al panorama regulatorio y de amenazas de 2025.

Como socio de servicios de nivel Premier de AWS, ofrecemos:

- Acceso anticipado a las funciones de cumplimiento más recientes de AWS (por ejemplo, actualizaciones de medidas de protección de Bedrock antes de GA

- Implementaciones certificadas del marco bien arquitecturado de AWS para IA

- Responsabilidad compartida para la preparación de la auditoría: gestionamos las herramientas de cumplimiento de AWS para que usted no tenga que hacerlo Cumplimiento de 2025 – Impulsado por AWS

| Regulación | Función de AWS para aprovechar |

|---|---|

| EO 14179 de EE. UU. | Tarjetas de servicio de IA de AWS |

| Ley de IA de la UE | Comprobaciones de conformidad de Bedrock |

| Leyes a nivel estatal | Generador de políticas de AWS |

El camino por delante

Ampliando la responsabilidad con la innovación

A medida que los sistemas de IA se vuelven más complejos, escalables e integrados en flujos de trabajo críticos, nuestra responsabilidad no disminuye, sino que crece. En Avahi, no solo estamos construyendo herramientas impulsadas por LLM y canalizaciones de automatización. Estamos construyendo sistemas en los que puede confiar: sistemas que justifican sus decisiones, protegen la privacidad y se adaptan a las nuevas leyes y riesgos.

Ya sea enmascarando datos confidenciales, citando la política de origen en un chatbot o alineándose con las medidas de protección en evolución de AWS Bedrock, nuestro trabajo sigue arraigado en la transparencia, la responsabilidad y la imparcialidad.

De cara al futuro, seguimos comprometidos a liderar con el ejemplo. Continuaremos colaborando con clientes, reguladores y la comunidad de código abierto para avanzar en la innovación ética y garantizar que los sistemas de IA eleven, no socaven, el potencial humano.