TL;DR

|

Los agentes de IA ya no son un concepto que se «prueba». Se están convirtiendo en software que actúa dentro de sistemas reales.

Si es responsable de la entrega, las operaciones, el producto o la ingeniería, este cambio importa por una razón: un agente no solo responde preguntas. Puede hacer avanzar el trabajo, paso a paso, con una supervisión limitada.

McKinsey informa que el 65% de los encuestados dice que sus organizaciones están utilizando regularmente la IA generativa. Gartner predice que para 2028, el 33% de las aplicaciones de software empresarial incluirán IA agentic, lo que permitirá que el 15% de las decisiones laborales cotidianas se tomen de forma autónoma.

Esta es la razón por la que el término «agente de IA» aparece en todas partes. Pero la etiqueta se usa a menudo de manera flexible, lo que dificulta la evaluación de lo que realmente está comprando, construyendo o implementando.

Este blog cubre qué es un agente de IA y en qué se diferencia de un chatbot, lo que le ayuda a comprender cuándo un sistema es realmente capaz de ejecutar el trabajo en lugar de simplemente responder a las indicaciones.

Agente de IA vs. Operación autónoma

Si está evaluando agentes de IA para un producto, equipo o flujo de trabajo, comience con dos fundamentos: qué es un agente y qué significa «autónomo» en términos operativos.

Agente de IA

Está tratando con un agente de IA, que es un sistema que puede interpretar lo que está sucediendo a su alrededor, determinar el siguiente paso y tomar medidas que lo acerquen a un objetivo. Opera en varios pasos en lugar de producir una sola respuesta aislada.

- Percibe un entorno: Recibe entradas de aplicaciones y API, como solicitudes de usuario, eventos del sistema, salidas de herramientas, archivos y datos.

- Decide qué hacer: Selecciona la siguiente acción en función del objetivo y la información disponible en ese momento.

- Toma medidas: Realiza acciones que hacen avanzar la tarea, como llamar a una herramienta, recuperar datos, actualizar un registro, generar un informe o iniciar un flujo de trabajo.

- Funciona a lo largo del tiempo: Continúa paso a paso hasta que se alcanza el objetivo, se alcanza un límite o se requiere una escalada.

Operación autónoma

Está evaluando el funcionamiento autónomo cuando el agente puede seguir tomando decisiones y tomando medidas sin necesidad de que especifique cada paso posterior, sin dejar de respetar las reglas y los límites definidos. Esto incluye tres requisitos:

- Usted define los límites por adelantado: Usted especifica a qué puede acceder el agente, qué acciones tiene permitido realizar y qué constituye la finalización.

- Procede sin indicaciones continuas: Después de recibir el objetivo, puede planificar la secuencia, ejecutar los pasos, supervisar el progreso y ajustarse cuando cambian las condiciones.

- Permanece dentro de las limitaciones: Opera dentro de límites explícitos, como permisos, presupuestos, controles de seguridad, tiempos de espera y puntos de control de aprobación.

Al determinar si un sistema es realmente un agente de IA, pregunte: ¿Puede percibir, decidir y actuar en varios pasos para lograr un objetivo?

Al determinar si funciona de forma autónoma, pregunte: ¿Puede continuar sin una guía paso a paso y permanecer dentro de los límites definidos?

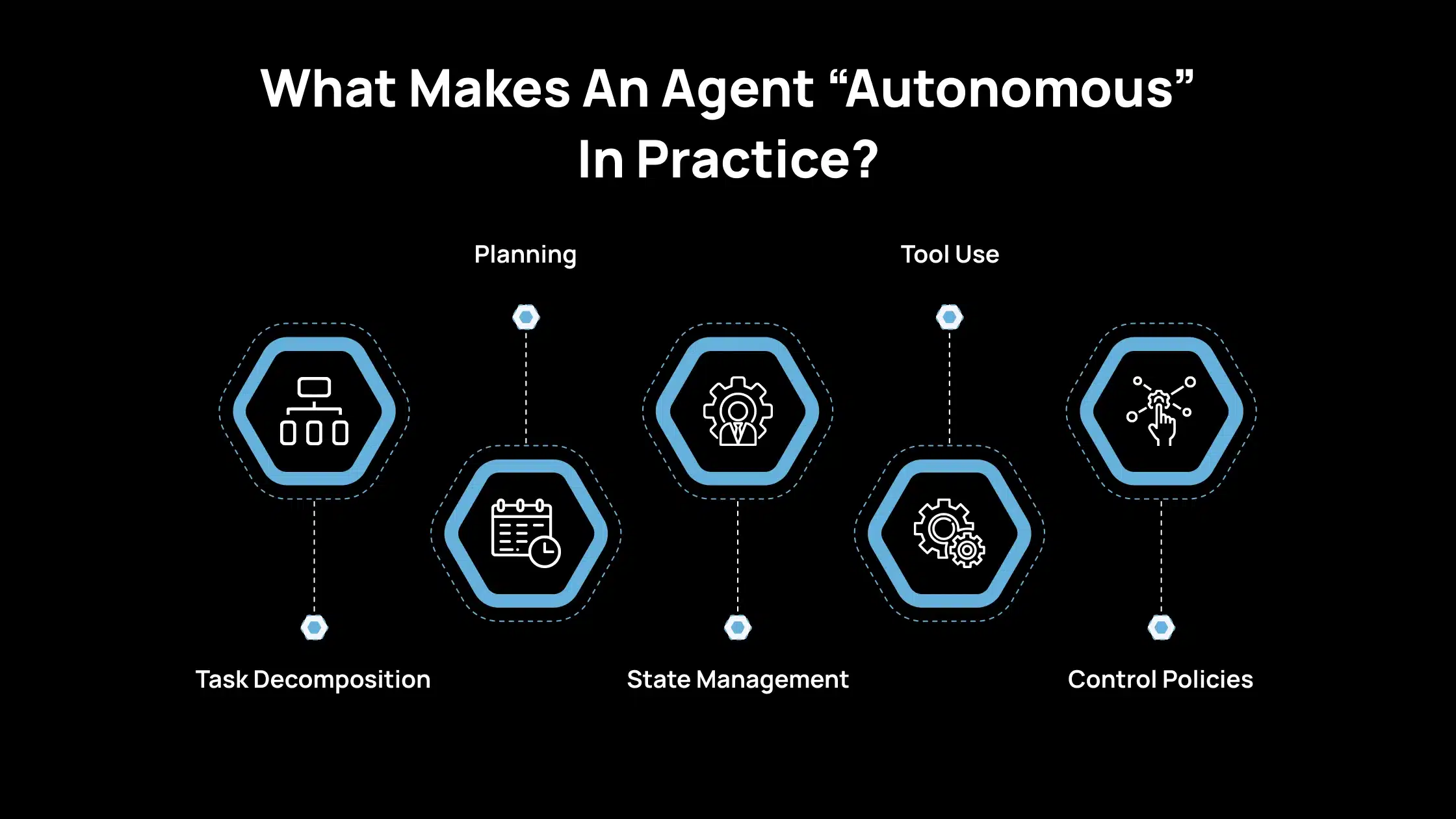

¿Qué hace que un agente sea «autónomo» en la práctica?

En la práctica, un agente es autónomo cuando puede llevar a cabo una tarea sin que usted especifique cada paso. Esa autonomía no es una característica única. Es una pila de capacidades que funcionan juntas.

1. Descomposición de tareas

Usted le da al agente un objetivo, y este divide ese objetivo en tareas más pequeñas que puede completar en orden. También realiza un seguimiento del progreso, por lo que sabe lo que está terminado, lo que está pendiente y lo que está bloqueado. Sin esto, el agente se detendrá antes de tiempo o repetirá el trabajo.

2. Planificación

El agente determina la secuencia de pasos e identifica sus dependencias. Puede revisar el plan cuando llega nueva información, como una entrada faltante, un requisito cambiado o una falla de la herramienta. La planificación mantiene el trabajo estructurado en lugar de reactivo.

3. Gestión del estado

El agente mantiene un registro fiable de lo que ha hecho y lo que queda por hacer. Esto incluye las salidas creadas hasta el momento, las decisiones tomadas, los resultados de las herramientas y cualquier restricción que establezca. La gestión del estado evita que el agente pierda el contexto entre los pasos y reduce la necesidad de acciones repetidas.

4. Uso de herramientas

El agente utiliza herramientas para recopilar datos, realizar cálculos e interactuar con los sistemas, en lugar de depender del modelo para «recordar» o adivinar. El uso de herramientas mejora la precisión y hace que los resultados sean auditables, ya que puede rastrear la fuente de información y las operaciones realizadas.

5. Políticas de control

El agente sigue los límites que usted define, como los presupuestos, los permisos, los límites de velocidad y las reglas para cuando es seguro actuar. Las políticas de control también incluyen las condiciones de parada y las reglas de escalada, que hacen que el agente se detenga o solicite la aprobación antes de tomar medidas de alto impacto. Esto es lo que hace que la autonomía sea aceptable en los sistemas reales.

¿En qué se diferencian los agentes de IA de los chatbots en los flujos de trabajo reales?

Si está comparando agentes de IA con chatbots o herramientas básicas de IA, la distinción es sencilla. Un agente está destinado a completar un objetivo. Un chatbot está diseñado para responder a las indicaciones.

Salida de un solo turno vs. Comportamiento dirigido a objetivos

Cuando utiliza un sistema de chat o de finalización, proporciona una indicación, genera una salida y la interacción termina. Cada respuesta es en gran medida independiente, y no existe un mecanismo inherente para mantener un objetivo o avanzar en una tarea a menos que siga dirigiéndola.

Cuando utiliza un agente de IA, proporciona un objetivo en lugar de una sola pregunta. El sistema mantiene el objetivo en el ámbito, realiza un seguimiento de lo que se ha completado y determina la siguiente acción. Puede operar en varios pasos, adaptarse cuando surge nueva información y detenerse solo cuando se completa la tarea o usted interviene.

En términos prácticos, un chatbot produce respuestas. Un agente avanza hacia un resultado.

La barra mínima para el comportamiento «agentic»

Para clasificar un sistema como un agente de IA, debe cumplir un conjunto básico de requisitos. Sin estos, sigue siendo una interfaz de solicitud-respuesta.

- Percepción: Debe esperar que un agente acepte entradas de su entorno, no solo texto de usuario. Esto incluye mensajes de usuario, archivos, respuestas de API, eventos del sistema, registros y otras señales estructuradas. Estas entradas proporcionan el contexto necesario para determinar lo que debe suceder a continuación.

- Decisión: Un agente debe ser capaz de seleccionar la siguiente acción. Las reglas explícitas, un componente de planificación o una política aprendida pueden impulsar esto. El punto crítico es que las decisiones están ligadas al objetivo y al estado actual, no solo a la indicación más reciente.

- Acción: Un agente debe ser capaz de realizar acciones, como llamar a herramientas, escribir o actualizar datos, iniciar flujos de trabajo o interactuar con sistemas operativos. Estas acciones deben producir un progreso significativo, no solo texto adicional.

- Persistencia: Debería poder dejar que el agente continúe a través de los pasos y con el tiempo. Realiza un seguimiento de lo que se ha hecho, lo que queda y cuándo debe detenerse. Esta persistencia es necesaria para la ejecución de varios pasos sin una supervisión constante.

Si un sistema no puede percibir nuevas entradas, tomar decisiones, ejecutar acciones y continuar a través de los pasos, no debe tratarse como un agente. Es una interfaz conversacional.

Tipos comunes de agentes de IA y dónde encaja cada uno

Al determinar qué tipo de «agente de IA» es apropiado, ayuda a clasificar los sistemas en dos categorías: tipos de agentes clásicos y agentes modernos basados en LLM. Esto mantiene la evaluación clara y práctica.

Tipos de agentes clásicos

1. Agentes de reflejo simples

Este tipo es apropiado cuando el comportamiento se puede definir a través de desencadenantes claros. Sigue reglas de condición-acción como «si ocurre X, realizar Y». Es eficaz en entornos estables donde las reglas siguen siendo coherentes.

2. Agentes de reflejo basados en modelos

Este tipo es apropiado cuando la entrada actual por sí sola es insuficiente. Mantiene un estado interno, lo que le permite incorporar el contexto anterior y responder con mayor precisión. Esto ayuda en situaciones en las que las decisiones dependen de lo que sucedió antes, no solo de lo que está sucediendo ahora.

3. Agentes basados en objetivos

Este tipo es apropiado cuando lograr un resultado definido es la prioridad. Planifica acciones para alcanzar un objetivo, seleccionando los pasos que lo acercan a la finalización. Es útil para tareas de varios pasos con dependencias y requisitos de ordenación.

4. Agentes basados en la utilidad

Este tipo es apropiado cuando existen compensaciones y la opción «mejor» importa. Optimiza una función de puntuación, como minimizar el costo, reducir el riesgo, mejorar la velocidad o aumentar la precisión. Esto es adecuado para escenarios que requieren una lógica de decisión coherente en lugar de aproximaciones aceptables.

Agentes modernos basados en LLM

1. El lenguaje como interfaz de control

Con los agentes basados en LLM, a menudo proporciona instrucciones en lenguaje natural, y el sistema las traduce en un plan y acciones de herramientas. Dependiendo de la implementación, puede expresar los pasos como texto o salidas estructuradas. Esto aumenta la flexibilidad, pero hace que el diseño de restricciones sea más crítico.

2. Razonamiento + acciones solicitadas

Estos agentes operan a través de ciclos iterativos en los que determinan el siguiente paso y luego toman una acción, como buscar, leer un archivo o llamar a una API. Patrones como ReAct admiten la recopilación de información durante la ejecución en lugar de depender de suposiciones.

Las categorías de agentes clásicos describen cómo se toman las decisiones. Los agentes basados en LLM cambian la forma en que se producen los planes y las acciones. En ambos casos, la fiabilidad mejora cuando los objetivos son explícitos, los límites se aplican y las salidas se validan antes de afectar a los sistemas operativos.

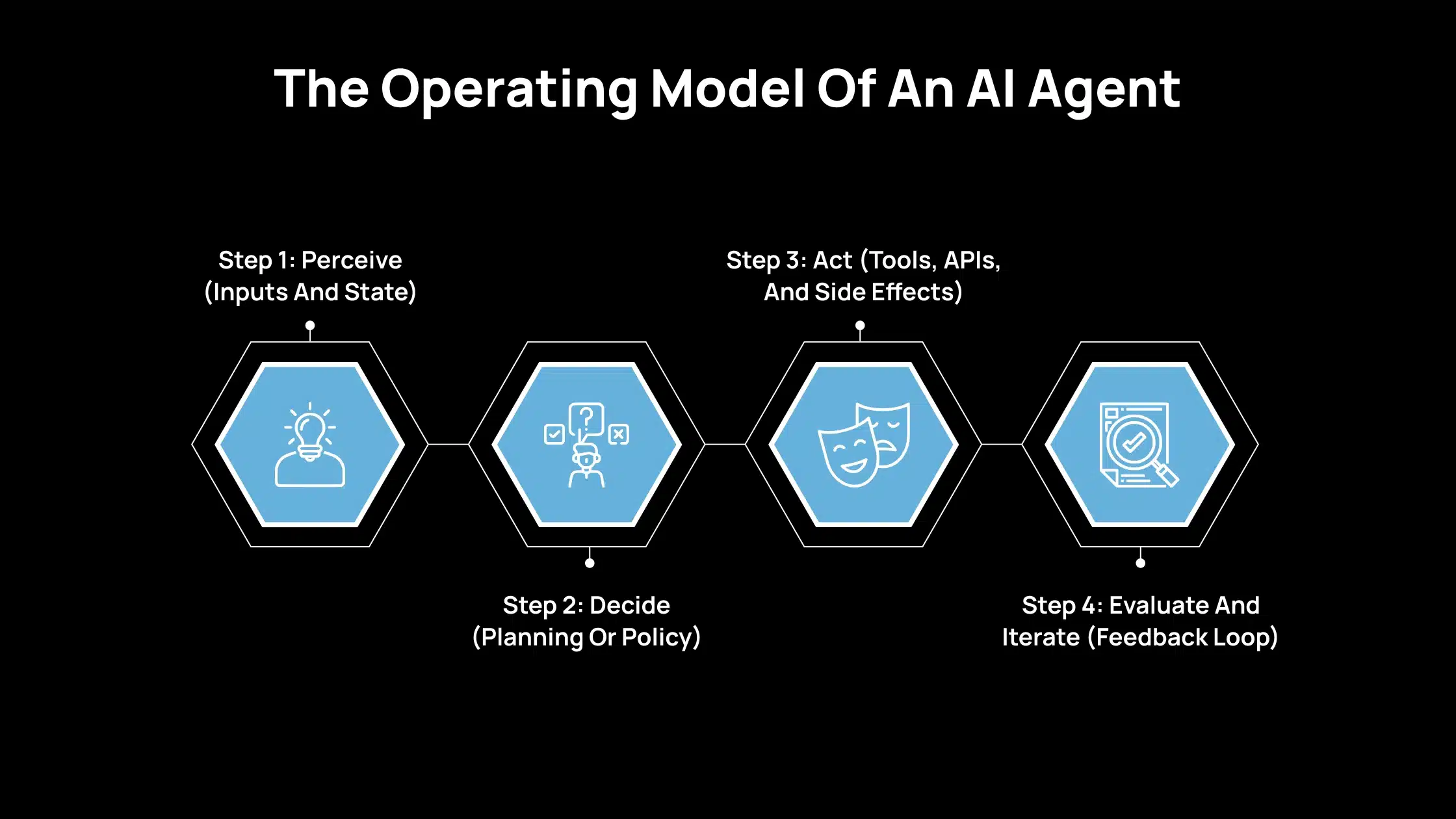

El modelo operativo de un agente de IA

Si desea evaluar si un agente de IA puede operar de forma independiente, examine cómo ejecuta este bucle. Los agentes autónomos repiten estos pasos hasta que se alcanza el objetivo, se alcanza una restricción o se detiene la ejecución.

Paso 1: Percibir (entradas y estado)

Comience por identificar lo que el agente puede observar en un momento dado. Esto incluye la nueva información entrante y el contexto que se lleva adelante desde los pasos anteriores.

El estado externo incluye su solicitud, los eventos del sistema (como errores o nuevos tickets), las salidas de herramientas, los resultados web o de búsqueda y los registros de la base de datos. Si un agente no puede obtener de forma fiable las entradas actuales, es más probable que se base en suposiciones.

El estado interno incluye el plan activo, las salidas parciales, las notas o la memoria almacenadas, las restricciones definidas (permisos, presupuestos, reglas) y un registro de las acciones anteriores. El estado interno es esencial porque el trabajo de varios pasos falla rápidamente cuando un sistema no puede realizar un seguimiento de lo que ya intentó.

Paso 2: Decidir (planificación o política)

A continuación, evalúe cómo el agente determina su siguiente acción. Esta capa impulsa la previsibilidad, la adaptabilidad y el riesgo operativo.

Decisiones basadas en reglas

Este es el enfoque más sencillo. Si se cumple una condición, el sistema ejecuta una acción predefinida. Se adapta a flujos de trabajo estables que requieren un comportamiento coherente. Su limitación es la reducción del rendimiento en situaciones novedosas.

Decisiones basadas en modelos

Aquí, el agente se basa en una representación interna para estimar los resultados de las acciones potenciales. Este enfoque es práctico cuando las condiciones varían y las reglas son insuficientes. La contrapartida es una mayor complejidad del sistema y una mayor dependencia de los datos de alta calidad.

«Planificador + ejecutor» basado en LLM

Este enfoque es común en los sistemas modernos. El modelo propone el siguiente paso, utiliza herramientas para recopilar la información que falta y actualiza el plan en función de los resultados. Funciona bien en tareas abiertas, pero requiere restricciones y verificación explícitas porque las acciones plausibles no siempre son correctas.

ReAct como patrón práctico

En muchas implementaciones, el agente alterna entre pasos de razonamiento cortos y acciones de herramientas. Identifica la información que necesita, la recupera mediante una herramienta y actualiza sus decisiones en función del resultado. El principal beneficio es la reducción de la dependencia de las suposiciones durante la ejecución.

Paso 3: Actuar (herramientas, API y efectos secundarios)

Aquí es donde el agente pasa de generar texto a realizar trabajo operativo. Es esencial distinguir el uso de herramientas de las acciones que crean efectos secundarios.

Llamadas a herramientas

Estas son acciones que recuperan o procesan información, como buscar, realizar cálculos, ejecutar consultas de bases de datos, crear tickets, ejecutar código y redactar correos electrónicos. Las llamadas a herramientas suelen ser de menor riesgo, especialmente cuando se diseñan como operaciones de solo lectura o no destructivas.

Efectos secundarios

Estas son acciones que modifican los sistemas externos, como escribir en un CRM, crear o fusionar una solicitud de extracción, enviar un mensaje de Slack o programar un trabajo. Los efectos secundarios son la principal fuente de riesgo operativo.

Una vez que un agente puede modificar los sistemas, tres controles se vuelven obligatorios: permisos (a lo que puede acceder y cambiar), registro (qué acciones tomó) y condiciones de parada (cuándo debe detenerse en lugar de continuar). Sin estos controles, la autonomía se vuelve difícil de gestionar.

Paso 4: Evaluar e iterar (bucle de retroalimentación)

Después de tomar una acción, el agente debe verificar el progreso y decidir si continúa. Esto es necesario para evitar bucles innecesarios y reducir la propagación de errores.

Autocomprobaciones

El agente comprueba la alineación con el objetivo y las restricciones. Las comprobaciones típicas incluyen la cobertura de requisitos, la integridad estructural y la coherencia con los límites establecidos.

Comprobaciones externas

Cuando la corrección es esencial, se requiere una validación externa. Esto incluye pruebas automatizadas, validadores de esquemas, filtros de políticas, revisión humana y reglas de supervisión que detectan un comportamiento anormal. Las comprobaciones externas importan porque la confianza del modelo no garantiza la corrección.

Condiciones de parada

Un agente fiable se detiene cuando es apropiado. Las condiciones de parada comunes incluyen la finalización del objetivo, los límites de tiempo o presupuesto, los umbrales de confianza, las fallas repetidas de las herramientas y los desencadenantes de políticas. Sin condiciones de parada explícitas, la autonomía aumenta los costos y eleva el riesgo de acciones no deseadas.

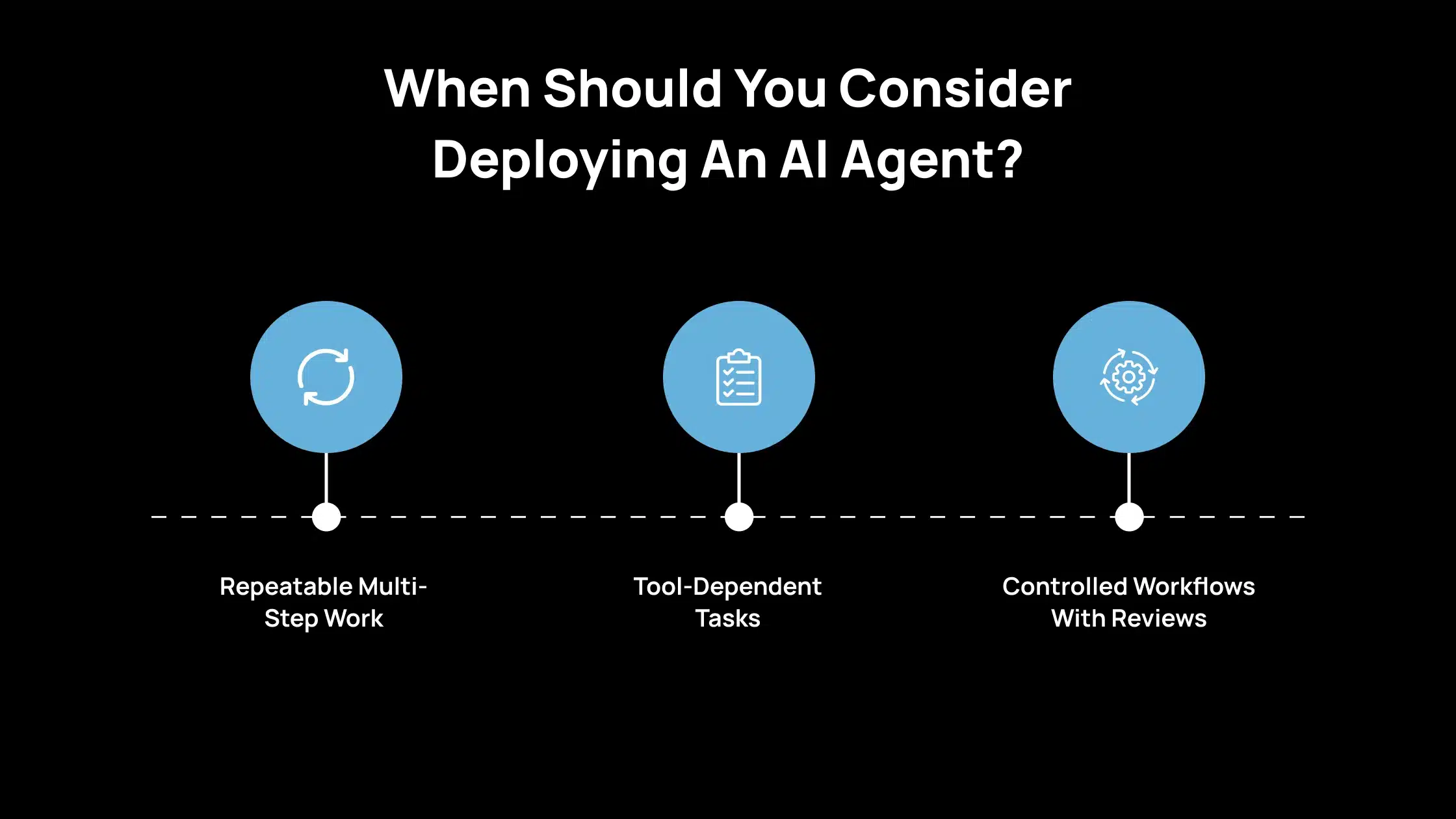

¿Cuándo debería considerar la posibilidad de implementar un agente de IA?

Seleccionar un agente de IA es una buena decisión. Debe utilizar un agente cuando el trabajo sea de varios pasos, medible y pueda ejecutarse dentro de límites controlados. Debe evitar un agente cuando la tarea sea de alto riesgo, poco clara o no pueda validarse de forma fiable.

1. Trabajo repetible de varios pasos

Utilice un agente de IA cuando la tarea siga un proceso repetible y la salida pueda verificarse con los requisitos definidos.

Algunos ejemplos son la generación de informes semanales, la preparación de informes estructurados, la conversión de notas de reuniones en elementos de acción, la actualización de la documentación o la recopilación de investigaciones de fuentes aprobadas. La condición esencial es que pueda definir qué aspecto tiene «completo» y verificarlo.

2. Tareas que dependen de herramientas

Utilice un agente cuando la tarea dependa de hechos, información actual o cálculos precisos. El acceso a las herramientas permite al agente recuperar datos de sistemas aprobados, ejecutar cálculos y hacer referencia a las salidas de origen, en lugar de depender de suposiciones no admitidas.

Esto encaja bien con tareas como extraer métricas de un panel de control, comprobar registros en una base de datos, validar totales o recopilar información de varios sistemas internos.

3. Flujos de trabajo controlados con revisiones

Utilice un agente cuando pueda limitar su alcance e introducir pasos de revisión antes de que se produzca cualquier acción de alto impacto.

Esto incluye ejecutar el agente en modo de solo lectura, restringir el acceso de escritura a campos específicos, aplicar presupuestos y tiempos de espera, y exigir la aprobación antes de enviar mensajes, actualizar registros de clientes o activar cambios en la producción. El agente es más eficaz cuando el flujo de trabajo admite la reversión, la auditoría y la escalada humana cuando es necesario.

¿Cómo las soluciones de IA de Avahi ofrecen valor empresarial real?

Si busca aplicar la IA de forma práctica para obtener resultados medibles, las soluciones de Avahi abordan directamente las necesidades empresariales prácticas. Avahi ayuda a las organizaciones a adoptar capacidades de IA potentes de forma segura y rápida, basadas en una sólida base en la nube con la experiencia de AWS.

Las capacidades básicas de IA incluyen:

- Chatbots inteligentes: atención al cliente y participación las 24 horas del día, los 7 días de la semana con comprensión del lenguaje natural.

- Agentes de voz con IA: Interacciones de voz automatizadas que capturan clientes potenciales, programan llamadas y reducen las oportunidades perdidas.

- Resúmenes y generación de contenido: Produzca resúmenes de alta calidad, borradores de contenido y resultados creativos rápidamente, ahorrando tiempo en tareas de escritura repetitivas.

- Extracción de datos estructurados: Convierta datos no estructurados (PDF, documentos) en información útil rápidamente.

- Análisis predictivo y previsión: Obtenga información prospectiva para planificar mejor y actuar antes.

- Análisis de imágenes y vídeos: Identifique patrones y extraiga significado del contenido visual para uso operativo o de marketing.

- Herramientas de consulta y NL2SQL: Utilice el lenguaje natural para hacer preguntas sobre sus datos y obtener respuestas precisas sin necesidad de conocimientos técnicos de SQL.

- Herramientas de enmascaramiento de datos y cumplimiento normativo: Proteja los datos confidenciales y mantenga el cumplimiento normativo sin problemas.

- Traducción e internacionalización de idiomas: Atraiga a audiencias globales traduciendo contenido con precisión utilizando A

Cuando se asocia con Avahi, obtiene un equipo con una profunda experiencia en IA y la nube, listo para adaptar las soluciones a sus desafíos específicos. Su objetivo es ayudarle a lograr resultados medibles, como la automatización que ahorra tiempo, el análisis que informa la toma de decisiones y las interacciones impulsadas por la IA que mejoran la experiencia del cliente.

Descubra la plataforma de IA de Avahi en acción

En Avahi, capacitamos a las empresas para que implementen una IA generativa avanzada que agilice las operaciones, mejore la toma de decisiones y acelere la innovación, todo ello con cero complejidad.

Como su socio de consultoría de AWS Cloud de confianza, capacitamos a las organizaciones para que aprovechen todo el potencial de la IA, garantizando al mismo tiempo la seguridad, la escalabilidad y el cumplimiento con las soluciones en la nube líderes del sector.

Nuestras soluciones de IA incluyen

- Adopción e integración de la IA : aproveche Amazon Bedrock y GenAI para mejorar la automatización y la toma de decisiones.

- Desarrollo de IA personalizado : cree aplicaciones inteligentes adaptadas a las necesidades de su negocio.

- Optimización de modelos de IA – Cambie sin problemas entre modelos de IA con comparaciones automatizadas de costes, precisión y rendimiento.

- Automatización de la IA – Automatice las tareas repetitivas y libere tiempo para el crecimiento estratégico.

- Seguridad avanzada y gobernanza de la IA – Garantice el cumplimiento, detecte el fraude e implemente modelos seguros.

¿Quiere desbloquear el poder de la IA con seguridad y eficiencia de nivel empresarial?

¡Comience hoy mismo su transformación de la IA con avahi!

Preguntas frecuentes

1. ¿Qué es un agente de IA?

Un agente de IA es un sistema que puede percibir entradas, decidir el siguiente paso y tomar medidas para alcanzar un objetivo en varios pasos, a menudo utilizando herramientas y sistemas conectados.

Está diseñado para avanzar de un paso a otro en función de los resultados, en lugar de detenerse después de una sola respuesta. En la práctica, combina la lógica de decisión con la ejecución, por lo que se utiliza para flujos de trabajo en lugar de solo conversaciones.

2. ¿En qué se diferencia un agente de IA de un chatbot?

Un chatbot responde principalmente a las indicaciones con texto. Un agente de IA trabaja para lograr un objetivo, realiza un seguimiento del progreso y puede realizar acciones como llamar a herramientas, actualizar registros o activar flujos de trabajo. Un chatbot suele limitarse al intercambio de información, mientras que un agente puede realizar tareas que afectan a los sistemas y los resultados. Si necesita una finalización de varios pasos y una ejecución controlada, un agente es la categoría más relevante.

3. ¿Son seguros los agentes de IA para su uso en sistemas empresariales?

Pueden serlo, si aplica medidas de seguridad como permisos limitados, registro de acciones, condiciones de parada claras y aprobación humana para acciones de alto impacto, como enviar mensajes o editar datos de producción.

La seguridad depende de cómo se configure el acceso y de si las acciones son auditables y reversibles. En la mayoría de las organizaciones, los agentes deben comenzar en modo de solo lectura y ampliar los permisos solo después de la validación.

4. ¿Cuándo debe utilizar un agente de IA?

Utilice un agente de IA para trabajos repetibles de varios pasos con criterios de éxito claros, especialmente cuando el acceso a las herramientas mejora la precisión y el flujo de trabajo incluye puntos de revisión antes de los cambios críticos.

Es una buena opción cuando puede definir claramente la finalización y verificar el resultado con respecto a los requisitos. Si la tarea requiere una ejecución coherente en todos los pasos, un agente reduce la coordinación manual y el seguimiento.

5. ¿Necesitan los agentes de IA acceso a herramientas y API?

Para la mayoría de los casos de uso del mundo real, sí. Las herramientas y las API ayudan al agente a recuperar datos fiables, ejecutar cálculos e interactuar con los sistemas, en lugar de depender de suposiciones.

Sin herramientas, un agente se limita a la generación de texto y no puede completar tareas operativas de extremo a extremo. El acceso a las herramientas también mejora la trazabilidad, ya que puede realizar un seguimiento de qué fuentes se utilizaron y qué acciones se tomaron.